Các chuyên gia trực quan hóa y sinh học vẫn chưa tìm ra cách sử dụng hay có nên sử dụng các công cụ AI tạo sinh khi tạo hình ảnh cho các ứng dụng y tế và khoa học. Nhưng có nhu cầu cấp thiết phải phát triển các hướng dẫn và thực hành tốt nhất vì các minh họa sai về giải phẫu và các vấn đề liên quan có thể gây hại trong môi trường lâm sàng hoặc như thông tin sai lệch trực tuyến.

Các nhà nghiên cứu từ Đại học Bergen ở Na Uy, Đại học Toronto ở Canada, và Đại học Harvard ở Mỹ đưa ra quan điểm này trong một bài báo có tựa đề "'Nó trông sexy nhưng nó sai.' Căng thẳng giữa sáng tạo và độ chính xác khi sử dụng GenAI cho trực quan hóa y sinh học," dự kiến được trình bày tại hội nghị Vis 2025 của IEEE vào tháng 11.

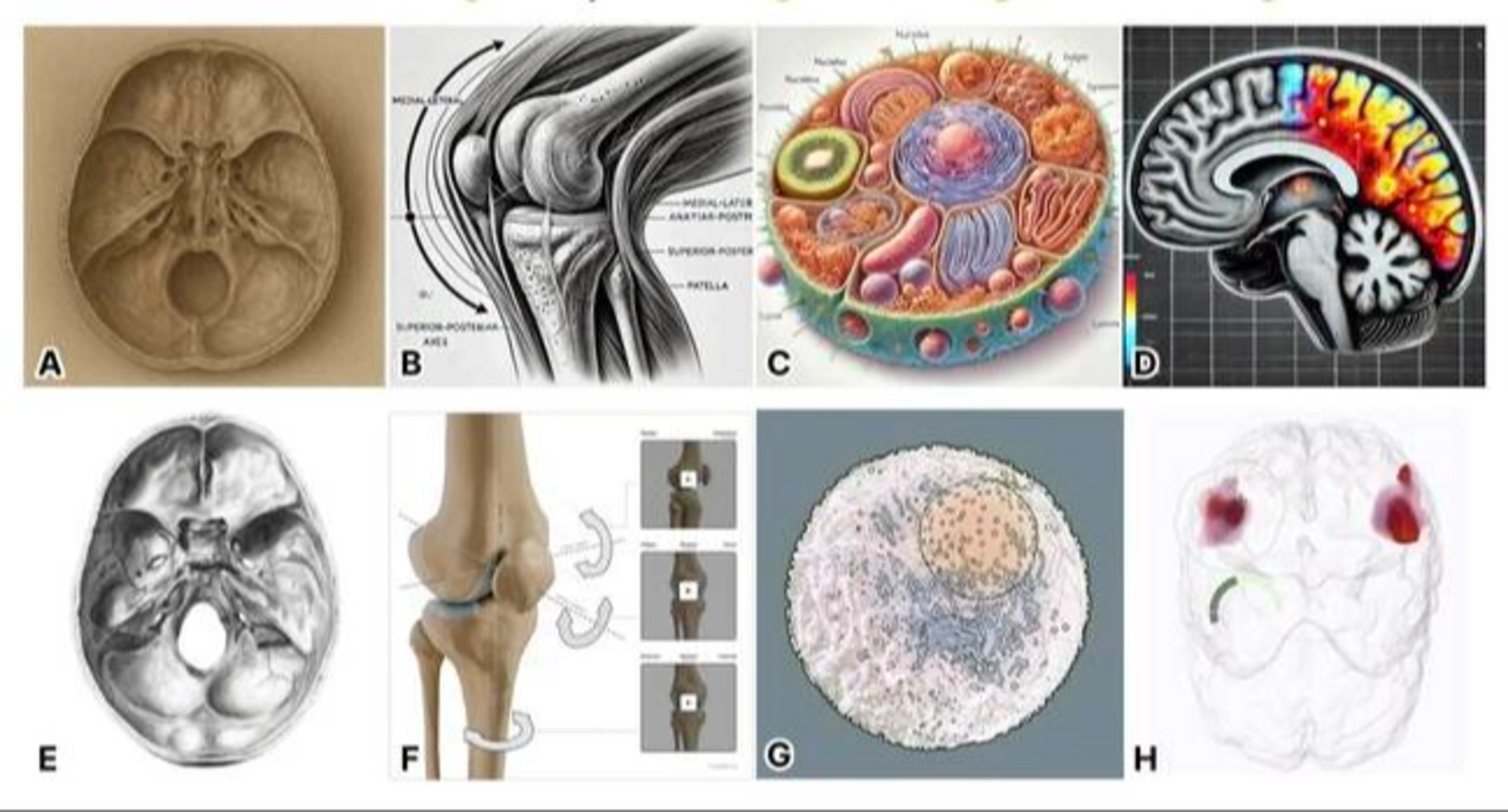

Trong bài báo của họ, các tác giả Roxanne Ziman, Shehryar Saharan, Gaël McGill, và Laura Garrison trình bày các minh họa khác nhau được tạo bởi GPT-4o hoặc DALL-E 3 của OpenAI cùng với các phiên bản được tạo bởi các chuyên gia trực quan hóa.

Một số ví dụ được trích dẫn khác biệt với thực tế theo những cách tinh vi. Những cái khác, như "con chuột nổi tiếng với bộ phận sinh dục khổng lồ" trong một bài báo hiện đã bị rút lại được xuất bản trên Frontiers in Cell and Developmental Biology (Tiến tuyến trong Sinh học Tế bào và Phát triển), sẽ khó có thể nhầm lẫn với bất cứ thứ gì khác ngoài tưởng tượng.

Dù thế nào đi nữa, hình ảnh được tạo bởi AI tạo sinh có thể trông đẹp nhưng không nhất thiết chính xác, các tác giả nói.

"Trong bối cảnh GPT-4o Image Generation được phát hành công khai tại thời điểm viết bài này, hình ảnh được sản xuất bởi GenAI thường trông bóng bẩy và chuyên nghiệp đủ để bị nhầm lẫn với các nguồn thông tin đáng tin cậy," các tác giả nêu trong bài báo của họ.

"Ảo tưởng về độ chính xác này có thể khiến mọi người đưa ra những quyết định quan trọng dựa trên các biểu diễn có lỗi cơ bản, từ một bệnh nhân không có kiến thức hoặc đào tạo như vậy bị ngập trong 'rác' do AI tạo ra có vẻ chính xác, đến một bác sĩ lâm sàng có kinh nghiệm đưa ra những quyết định quan trọng về cuộc sống con người dựa trên hình ảnh hoặc mã được tạo bởi một mô hình không thể đảm bảo độ chính xác 100%."

Hãy cho tôi xem tuyến tụy, và MidJourney giống như, đây là đống trứng người ngoài hành tinh của bạn!

Đồng tác giả Ziman, một nghiên cứu sinh tiến sĩ về nghiên cứu trực quan hóa tại Đại học Bergen, nói với The Register qua email, "Mặc dù tôi chưa gặp phải các ví dụ thực tế nào mà hình ảnh do AI tạo ra đã trực tiếp dẫn đến các kết quả có hại liên quan đến sức khỏe, một người tham gia phỏng vấn đã chia sẻ với chúng tôi trường hợp này liên quan đến hệ thống chấm điểm rủi ro dựa trên AI để phát hiện gian lận và đã cáo buộc sai (chủ yếu là các bậc cha mẹ nước ngoài) về gian lận trợ cấp chăm sóc trẻ em ở Hà Lan.

"Với hình ảnh do AI tạo ra, vấn đề phổ biến hơn là việc sử dụng hình ảnh không chính xác trong các ấn phẩm y tế và liên quan đến sức khỏe, và các ấn phẩm nghiên cứu khoa học nói chung. Mặc dù tác hại tiềm ẩn không rõ ràng ngay lập tức, việc gia tăng sử dụng các hình ảnh không chính xác như này, và các vấn đề như củng cố định kiến trong chăm sóc sức khỏe, để truyền đạt thông tin y tế và sức khỏe là đáng lo ngại."

Ziman nói rằng vấn đề lớn hơn, được lặp lại trong một loạt các cuộc phỏng vấn được thảo luận trong bài báo, là cách hình ảnh không chính xác ảnh hưởng đến cách công chúng nhìn nhận nghiên cứu khoa học. Cô chỉ ra "con chuột khổng lồ" và cách nó được giới thiệu trên The Late Show với Stephen Colbert.

"Phê bình châm biếm của những nhân vật công chúng như vậy (mà mọi người có thể tin tưởng hơn các nguồn tin tức 'hợp pháp') có thể đặt câu hỏi về tính hợp pháp của cộng đồng nghiên cứu khoa học nói chung, và công chúng có thể không tin tưởng (thậm chí hơn nữa) hoặc không coi trọng những gì họ nghe từ cộng đồng nghiên cứu khoa học," Ziman nói.

"Hãy nghĩ về hậu quả sau đó cho truyền thông sức khỏe cộng đồng như trong thời COVID, các chiến dịch vaccine, v.v. Và các tác nhân xấu giờ đây có khả năng dễ dàng hơn để nhanh chóng tạo ra và chia sẻ hình ảnh sai lệch nhưng trông thuyết phục."

Ziman nói rằng trong khi hình ảnh y tế do AI tạo ra thường được chia sẻ trong cộng đồng trực quan hóa y sinh học (BioMedVis) để cười và phê bình, các chuyên gia vẫn chưa tìm ra cách giảm thiểu rủi ro.

Hướng tới mục tiêu đó, các tác giả đã khảo sát 17 chuyên gia BioMedVis để đánh giá cách họ nhìn nhận các công cụ AI tạo sinh và cách họ sử dụng những công cụ đó trong công việc của mình. Những người trả lời khảo sát, được gọi bằng bí danh trong bài báo, báo cáo một loạt quan điểm rộng về AI tạo sinh. Các tác giả nhóm họ thành năm nhân cách: Người Chấp Nhận Nhiệt Tình, Người Thích Ứng Tò Mò, Người Lạc Quan Tò Mò, Người Lạc Quan Thận Trọng, và Người Tránh Né Hoài Nghi.

Một số người trả lời đánh giá cao tính thẩm mỹ trừu tượng và siêu thực của hình ảnh được tạo bởi các mô hình AI, nói rằng hình ảnh giúp thúc đẩy cuộc trò chuyện với khách hàng. Những người khác (khoảng một nửa) phê bình phong cách GenAI, đồng ý với "Frank," người nói rằng vẻ ngoài chung chung trong những hình ảnh đó thật nhàm chán.

Các tham chiếu không liên quan hoặc ảo giác vẫn là một vấn đề, cũng như các thuật ngữ mới được phát minh, chẳng hạn như 'protein phát sáng xanh.'

Những người tham gia khảo sát đôi khi cũng sử dụng các mô hình văn bản-thành-văn bản cho chú thích và hỗ trợ mô tả, mặc dù không phải lúc nào cũng làm hài lòng những người trả lời. Như bài báo quan sát, "Các tham chiếu không liên quan hoặc ảo giác vẫn là một vấn đề, cũng như các thuật ngữ mới được phát minh, chẳng hạn như 'protein phát sáng xanh."

Một số người trả lời khảo sát coi AI tạo sinh hữu ích để xử lý các nhiệm vụ lập trình rote, như tạo mã boilerplate hoặc làm sạch dữ liệu. Tuy nhiên, những người khác cảm thấy họ đã đầu tư thời gian học lập trình và thích sử dụng những kỹ năng đó hơn là ủy thác chúng.

Các nhà nghiên cứu cũng lưu ý một thái độ mâu thuẫn giữa những người trả lời, những người "bày tỏ mối quan tâm nghiêm trọng về vi phạm sở hữu trí tuệ được, hiện tại, nướng vào các công cụ GenAI công cộng" khi sử dụng chúng cho mục đích thương mại, trong khi cũng phần lớn chấp nhận việc sử dụng AI tạo sinh trên cơ sở cá nhân.

Mặc dù 13 trong số 17 người được khảo sát đã kết hợp GenAI vào quy trình sản xuất của họ ở một mức độ nào đó, các nhà phát triển và thiết kế BioMedVis vẫn ưu tiên độ chính xác trong hình ảnh của họ, và "GenAI ở trạng thái hiện tại không thể đạt được tiêu chuẩn này," các tác giả quan sát.

Họ chỉ ra những nhận xét được gán cho "Arthur": "Mặc dù nó vẫn đang cạo thế giới kỹ thuật số để tìm tham chiếu mà nó có thể sử dụng để tạo nghệ thuật, nó vẫn chưa thể biết sự khác biệt giữa dây thần kinh tọa và dây thần kinh trụ. Nó chỉ là, bạn biết đấy, dây điện."

Họ cũng trích dẫn "Ursula" về việc GenAI không thể tạo ra giải phẫu chính xác: "Hãy cho tôi xem tuyến tụy, và MidJourney giống như, đây là đống trứng người ngoài hành tinh của bạn!"

Bài báo nói rằng trong khi đầu ra AI sai lệch có thể rõ ràng trong nhiều trường hợp, những người BioMedVis mong đợi những lỗi này sẽ trở nên khó phát hiện hơn khi công nghệ cải thiện và khi mọi người trở nên quen thuộc với việc tin tưởng những hệ thống này.

Các nhà nghiên cứu cũng bày tỏ lo ngại rộng hơn về bản chất “hộp đen” của machine learning và những khó khăn trong việc xử lý thiên lệch.

Bài báo giải thích, "Đầu ra không chính xác hoặc không đáng tin cậy, cho dù là hình ảnh giải phẫu... hay các khối mã, có thể gây hiểu lầm và phân tán trách nhiệm. Những người tham gia đặt câu hỏi ai nên chịu trách nhiệm trong các trường hợp GenAI được sử dụng và ranh giới trách nhiệm mờ nhạt." Các mô hình hộp đen ngăn cản loại trách nhiệm đó. Như người trả lời khảo sát "Kim" nói, "Nên có ai đó có thể giải thích kết quả. Đó là về niềm tin, và [...] về năng lực."

Là một cộng đồng, chúng ta nên cảm thấy thoải mái chia sẻ suy nghĩ, câu hỏi và mối quan tâm của mình về những công cụ này

Đồng tác giả Shehryar Saharan từ Đại học Toronto nói với The Register qua email rằng ông hy vọng nghiên cứu này khuyến khích mọi người suy nghĩ phê phán về cách AI tạo sinh phù hợp với công việc và giá trị của các chuyên gia BioMedVis.

"Những công cụ này đang trở thành một phần lớn hơn trong lĩnh vực của chúng ta, và quan trọng là chúng ta không chỉ sử dụng chúng, mà phản ánh phê phán về ý nghĩa của chúng đối với cách chúng ta làm việc và tại sao chúng ta làm những gì chúng ta làm," Saharan nói.

"Là một cộng đồng, chúng ta nên cảm thấy thoải mái chia sẻ suy nghĩ, câu hỏi và mối quan tâm của mình về những công cụ này. Không có cuộc trò chuyện mở và sẵn sàng phản ánh, chúng ta có nguy cơ bị tụt lại phía sau hoặc sử dụng những công nghệ này theo cách không phù hợp với những gì chúng ta thực sự quan tâm. Đó là về việc tạo không gian để suy nghĩ và phản ánh trước khi chúng ta tiến lên."

Nghiên cứu này bộc lộ một thực tế báo động: AI tạo sinh đang tạo ra "ảo tưởng về độ chính xác" nguy hiểm trong lĩnh vực y học và sinh học. Mặc dù công nghệ này có thể tạo ra hình ảnh bắt mắt và chuyên nghiệp, nhưng độ chính xác khoa học vẫn là vấn đề lớn. Cộng đồng khoa học cần phát triển urgently các hướng dẫn và tiêu chuẩn nghiêm ngặt để ngăn chặn việc sử dụng AI sai cách có thể gây hại cho bệnh nhân và làm suy giảm niềm tin công chúng vào nghiên cứu khoa học.